9月10日报道,昨晚,英伟达又放AI计算大招,推出专为长上下文推理和视频生成应用设计的新型专用GPU——NVIDIA Rubin CPX

英伟达创始人兼CEO黄仁勋说:“正如RTX彻底改变了图形和物理AI一样,Rubin CPX是首款专为海量上下文AI打造的CUDA GPU,这种AI模型可以同时处理数百万个知识token的推理。”

Rubin CPX配备128GBGDDR7内存,NVFP4精度下AI算力可达30PFLOPS,非常适合运行长上下文处理(超过100万个token)和视频生成任务。

Vera Rubin NVL144 CPX平台可在单机架集成144张Rubin CPX GPU、144张Rubin GPU、36张Vera CPU,提供8EFLOPS的AI性能(NVFP4精度)和100TB的快速内存,内存带宽达到1.7PB/s

其AI性能是英伟达Vera Rubin NVL144平台的2倍多,是基于Blackwell Ultra的GB300 NVL72系统的7.5倍,相比GB300 NVL72系统还能提供3倍更快的注意力机制。

Rubin CPX GPU预计将于2026年底上市。

9月17日,智猩猩发起主办的2025全球AI芯片峰会将在上海举办。大会设有主论坛,大模型AI芯片、AI芯片架构两大专题论坛,以及存算一体、超节点与智算集群两大技术研讨会,近40位嘉宾将分享和讨论。IEEE Fellow王中风教授将开场,华为昇腾等国产AI芯片力量集结,华为云、阿里云领衔超节点与智算集群势力。扫码报名~

01.

全新专用GPU:

128GB内存,30PFLOPS算力

Rubin CPX基于NVIDIA Rubin架构构建,采用经济高效的单芯片设计,配备128GBGDDR7内存,采用NVFP4精度,并经过优化,算力可达30PFLOPS,能够为AI推理任务,尤其是长上下文处理(超过100万个token)和视频生成,提供了远超现有系统的性能和token收益。

与英伟达GB300 NVL72系统相比,这款专用GPU还提供了3倍更快的注意力机制,从而提升了AI模型处理更长上下文序列的能力,而且速度不会降低。

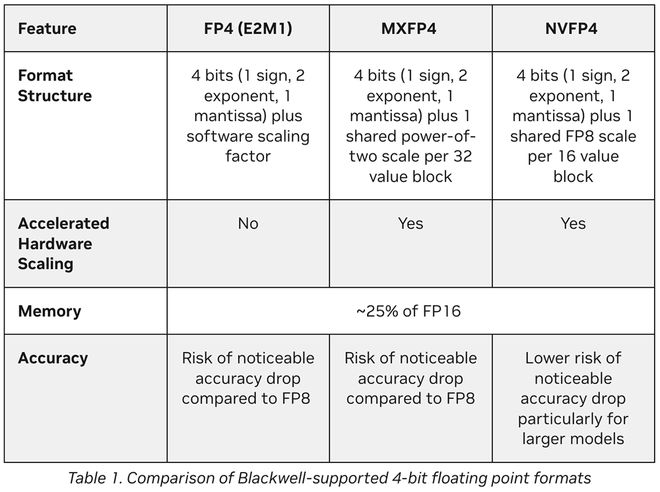

相比之下,今年3月发布的Rubin GPU,在FP4精度下峰值推理能力为50PFLOPS。而英伟达在今年6月才公布创新型4位浮点格式NVFP4,这种格式的目标是在超低精度下力求保持模型性能。