10月27日报道,10月25日,美团开源了其首款视频生成大模型——LongCat-Video。该模型面向多任务视频生成场景,旨在以统一架构支持文生视频、图生视频以及视频续写三种能力。

不同于以往针对单一任务训练的模型,LongCat-Video通过多任务联合训练机制,在同一框架内即可处理零帧、单帧及多帧条件输入。

此外,LongCat-Video重点突破了长视频生成难题。相比常见模型在长时序生成中易出现的画面漂移、色彩偏移等问题,该模型通过在视频续写任务上的原生预训练,能够持续生成数分钟视频内容,同时保持较高的时间一致性与视觉稳定性。

在推理效率方面,LongCat-Video借鉴了近年来的高效生成方法,采用“粗到细”两阶段生成策略:先生成480p、15fps的视频,再细化至720p、30fps,并结合块稀疏注意力机制和模型蒸馏,显著降低了高分辨率生成的计算开销,视频生成的推理速度提升到原来的10.1倍,提速幅度超900%。

在后训练阶段,团队引入多奖励强化学习(RLHF)优化方案,利用组相对策略优化(GRPO)方法综合多维度奖励信号,进一步提升模型在多样化任务下的表现。

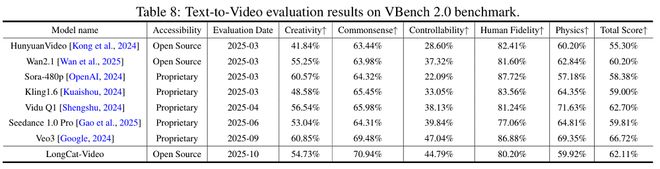

美团已在多项公开与内部测评中将LongCat-Video与其他视频生成大模型进行了比较。在VBench公开基准测试中,LongCat-Video总得分仅次于Veo3和Vidu Q1。值得注意的是,LongCat-Video在“常识理解”一项中以70.94%的得分位居所有开源模型第一,也超过了Veo3、Seedance 1.0 Pro、Vidu Q1、Kling 1.6、Sora等闭源模型。

目前,美团LongCat-Video已同步开放代码、模型权重及关键模块,模型技术报告也已经发布。