按从左到右的顺序依次生成下一个 token 真的是大模型生成方式的最优解吗?最近,越来越多的研究者对此提出质疑。其中,有些研究者已经转向一个新的方向 —— 掩码扩散语言模型(MDLM)。

和自回归(AR)语言模型不同,MDLM 的训练目标是随机遮蔽序列中的若干位置,模型学习去 in-fill(填充)这些被遮蔽位置。这样训练出来的模型存在诸多优势,如支持任意顺序解码、多 token 并行解码等。此前有研究表明,MDLM 的这些优势使其在数独等逻辑谜题上的表现得到显著提升。

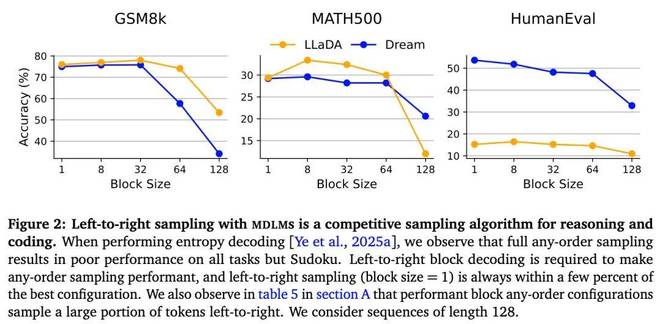

然而,最近的一篇论文有了一些意外发现:在数学和编码任务中,任意顺序算法的性能往往不如从左到右采样,或者表现与之相似,而标准的多 token 解码会显著降低性能。即使仅在两个 token 上进行并行解码,模型在主流基准任务上的性能也会显著下降。

使用 MDLM 进行从左到右的采样是一种适用于推理和编码的高效采样算法。如果没有 [Arriola et al., 2025] 提出的块大小(block sizes)来强制形成半自回归(AR)的从左到右结构,任意顺序会显著影响性能。

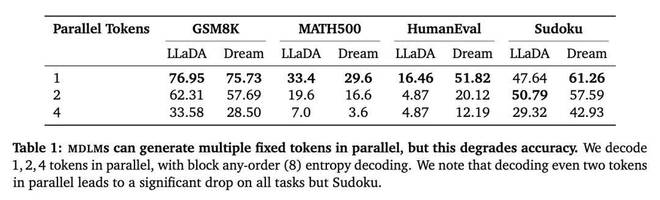

MDLM 能够并行生成多个固定 token,但这会降低准确性。作者使用块任意顺序熵解码,并行解码 1 个、2 个、4 个 token。可以看到,除数独外,在所有任务中,即使并行解码两个 token 也会导致性能显著下降。

这一结果引发了一个问题:既然 MDLM 在训练时投入了大量额外计算资源以建模所有被掩码位置的联合分布,那么这些额外的计算是否真的物有所值?

为了回答这个问题,研究者探究了如何将这些计算资源重新利用为有意义的推理与采样能力。他们证明,MDLM 提供了对所有掩码位置的条件分布的访问权限,并具备填充(in-filling)能力,这一特性解锁了传统 NTP 模型无法轻易实现的新型采样与后训练(post-training)机制。

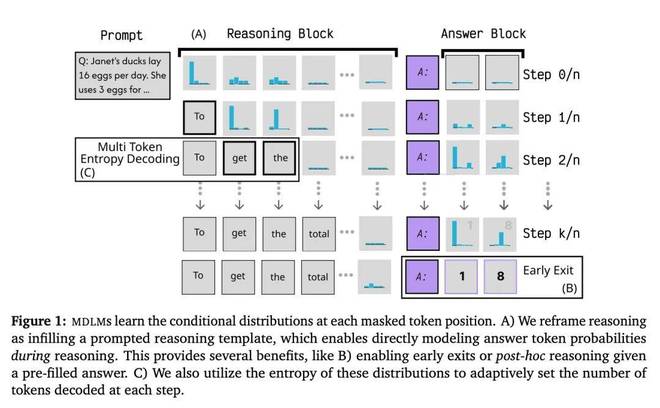

首先,研究者展示了 MDLM 的填充能力如何开启新的模型提示范式。在本文中,他们提出了「提示即填充」(prompting-as-infilling) 的方法。与 NTP 模型仅能在序列起始位置添加提示不同,这种方法允许在多个位置添加由用户指定的上下文。

更具体地,他们提出了「推理即填充」(reasoning-as-infilling) 的框架。在该框架中,研究者预先构造了一个显式的「推理模板」(reasoning template),其中包含特定的推理位置与答案位置(参见图 1)。这一模板结构使得模型能够基于给定的推理预算和格式,对推理轨迹进行采样。